Blog

Gedanken und Erfahrungen rund um Technik, KI-Werkzeuge und Hobbyprojekte. Kein Tutorial-Blog, sondern ehrliche Berichte aus der Praxis.

Mermaid-Diagramme im Ayu-Theme: Praxisleitfaden für den Blog

Mermaid ist eine textbasierte Diagrammsprache, mit der sich technische Zusammenhänge direkt in Markdown dokumentieren lassen. Für den Blog ist das besonders nützlich, weil Diagramme versionierbar bleiben, sich in Pull Requests prüfen lassen und im gleichen redaktionellen Workflow entstehen wie der restliche Inhalt.

Obsidian als KI-gestützte Wissensdatenbank — Vom Karpathy-Konzept zur vollständigen Automatisierung

Anfang April 2026 hat Andrej Karpathy — Ex-Tesla-KI-Chef, OpenAI-Mitgründer und einer der einflussreichsten Köpfe im Machine-Learning-Bereich — eine bemerkenswerte Idee geteilt: Statt aufwendiger RAG-Pipelines einfach eine Markdown-Wiki aufbauen, die ein LLM selbst pflegt. Kein Vektorstore, keine Embedding-Pipeline, keine zusätzliche Infrastruktur. Nur Obsidian, Markdown-Dateien und ein LLM als Bibliothekar. Sein GitHub Gist beschreibt einen Ansatz, der sich in ähnlicher Form auch in der Praxis bewährt hat — und der es wert ist, genauer betrachtet zu werden. Dieser Artikel zeigt, wie aus Karpathys Grundidee ein vollständig automatisiertes System werden kann: mit spezialisierten Agenten, die Recherchen verarbeiten, Journals führen, Trainingsdaten analysieren und Aufgaben verwalten.

Ein Hugo-Theme von Grund auf — mit Split-Flap-Display als Herzstück

Eine persönliche Website braucht nicht zwangsläufig ein fertiges Theme von der Stange. Wenn die Vorstellungen spezifisch genug sind — eine mechanische Anzeigetafel als Startseite, ein bestimmtes Farbschema, eine durchgängige Monospace-Typografie — lohnt es sich, das Theme selbst zu bauen. So entstand parallel zur Website hnsstrk.de ein eigenständiges Hugo-Theme, das sich um ein zentrales visuelles Element dreht: ein Split-Flap-Display als Landing Page.

Lokale KI mit Ollama — Praxis, Grenzen und was YouTube verschweigt

Lokale KI-Modelle haben sich von einem Nischenprojekt zu einer ernst zu nehmenden Alternative zu Cloud-Diensten entwickelt. Ollama macht den Einstieg niedrigschwellig — ein einzelner Befehl genügt, um ein Sprachmodell auf der eigenen Hardware zu starten. Was in den meisten YouTube-Tutorials fehlt, ist eine ehrliche Einordnung der Grenzen. Dieser Artikel verbindet beides: einen praktischen Einstieg und eine nüchterne Perspektive.

KI-Assistenten im Terminal — Ein Einsteigerleitfaden

Wer Software entwickelt, Systeme administriert oder viel in der Kommandozeile arbeitet, kennt den üblichen Ablauf: Editor öffnen, Code schreiben, in den Browser wechseln, eine KI-Chat-Oberfläche befragen, zurück zum Editor, Antwort einarbeiten. Seit 2025 gibt es dafür eine deutlich direktere Alternative: KI-Assistenten, die direkt im Terminal laufen, Dateien lesen, Code schreiben, Befehle ausführen und den Arbeitsfluss nicht ständig unterbrechen. Dieser Artikel stellt die drei derzeit wichtigsten Vertreter vor — Claude Code, Gemini CLI und Codex CLI — und zeigt Schritt für Schritt, was sie können, was sie kosten und für wen welches Tool sinnvoll ist.

Hugo auf dem eigenen Server

Wer heute eine Website aufsetzen möchte, steht schnell vor einer Grundsatzfrage: ein dynamisches CMS wie WordPress oder ein Static Site Generator wie Hugo? Beide Ansätze haben ihre Berechtigung. Dieser Artikel beleuchtet die technischen Unterschiede, erklärt die Vorteile statischer Seiten und beschreibt ein konkretes Self-Hosting-Setup mit Hugo, Nginx und einer CI/CD-Pipeline über GitHub Actions.

CLAUDE.md richtig schreiben

Die CLAUDE.md ist weder Bedienungsanleitung noch Dokumentation noch Ablage für projektbezogene Notizen. Sie ist ein präzises Werkzeug — und funktioniert nur, wenn man sie auch so behandelt. Wer Claude Code wirksam konfigurieren will, profitiert von ein paar klaren Grundprinzipien. Die CLAUDE.md allein erzählt allerdings nur die halbe Geschichte. Seit Anfang 2026 bietet Claude Code ein ganzes Ökosystem aus Konfigurationsdateien, von dem die CLAUDE.md nur eine Ebene ist: Rules-Dateien für modulare Instruktionen, settings.json für technische Berechtigungen, Hooks für deterministische Automatisierung und ein Memory-System für lernende Kontexte. Wer alles in eine einzige Datei packt, verschenkt nicht nur Übersicht, sondern auch Wirksamkeit.

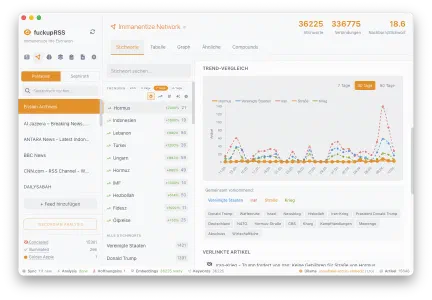

Ein RSS-Reader mit lokaler KI-Pipeline

fuckupRSS ist ein RSS-Aggregator mit einer 8-stufigen KI-Analyse-Pipeline, die vollständig lokal läuft — gebaut mit Rust, Svelte und Ollama, ohne Cloud, ohne API-Keys, ohne geteilte Daten. Der Ansatz: das klassische RSS-Problem mit lokaler KI spürbar zu entschärfen.